今回はご報告です。

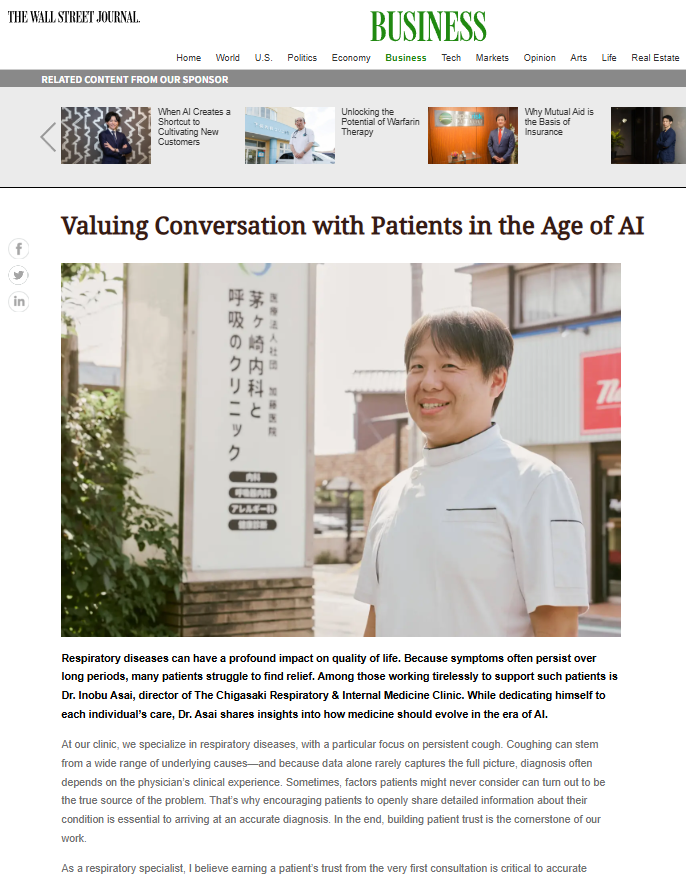

この度、私が、アメリカのウォール・ストリート・ジャーナル米国版の特集記事で取り上げられました。

ウォール・ストリート・ジャーナルは、アメリカを代表する新聞であり、世界の政治・経済だけでなく、社会や文化、テクノロジーなど幅広い分野を取り上げる国際的メディアです。

アメリカ国内で最大の発行部数を誇っているということであり、しかも今回は(日本語版ではなく)本国の英語版とのことで、完全に私のような場末の医師には極めて縁遠いメディアのはずなのですが・・・

今回は“Next ERA Leaders”という、「次の時代を形づくる可能性を持つ人物」という企画に取り上げられました。

なので、「医師」という肩書ではありながらも、いつもとちょっと違う立場での掲載で、ちょっとおしりがむずむずしています・・・(笑)

今回は特に「医療とAI」「AIではできない人間の医師としての医療の形」というテーマをメインに話してきました。

記事のリンクは一番下に用意しておりますので、後ほどご覧頂くとして、今回はそこからもう少し話を拡げて「AIが、そして人間の医師が医療でできること」について、私なりの考えをお話ししてみようかなと思います。

AIの知識に人間は敵わない

AIの登場以来、AIは毎年目覚ましい進歩を遂げ、医療の現場もAIにより大きく変わろうとしています。

近い将来、AIが人間の医師を駆逐するのではといった過激な論調もあります。

確かにAIは診断には非常に役立ちます(私も最大限活用しており、ChatGPTもgeminiも有料版に入り使い分けています)。

知識の面においては、いくら医師が知識を詰め込もうとも、やはりAIによる「集団知」の前においては、到底かなうはずもありません。

診断で大事な、正しい「インプット」

「診断」という行為は、患者さんから得た症状などの情報に対して、私たち医師がその情報をもとに推測しながら答えを見つける作業です。

患者さんから情報を得ることが「インプット」となり、医師が導き出した答えが「アウトプット」ということになります。

「圧倒的な知識量」を誇るAIは、「正確な情報のインプット」に対しては、実に正確なアウトプットを出してくれます。

しかし実際は、診療の場では、患者さんから正確なその「インプット」情報を導くことが、実は非常に難しいのです。

正しい「インプット」って、意外に難しい・・・

実際の診察では、患者さんが「何がわからないのかわからない」といった場面に、よく出くわします。

例えば、診察を始めた時に、患者さんは「自分が重要だと思っていること」をお話しになります。

しかし、私たち医師は、診断の見当をつけるために、患者さんとは違った視点で見ていくことが少なくありません。

患者さん自身が「まさか重要だとは思っていなかった」診断に不可欠なエピソードを、話を進める中ではじめて聞き出すことができることもあります。

そして、それが診断に決定的な影響を与えることもあるのです。

しかし、相手がAIだと、それらの情報はすべて患者さん自身が打ち込まないとなりません。

今の時点では、AIは、患者さんの表情や、話し方から見える性格などを参考にすることはできません。

すると、そこで導き出されたアウトプットがずれてしまうということが起き得るわけです。

加えて、その目の前にある答えが、ずれているかそうでないのか、患者さん側からは、それを判断することも難しく、「ブラックボックス」の状態ともいえる訳です。

つまり、その「インプット」を正確に聞き出す、ということが、私たち人間の医師の存在価値なのだと思うのです。

「治療方針」と「キャラクター」

また、ある病気に対して治療法がある場合、「その治療法が患者さんのキャラクターに合っているか」どうかというのも、治療を継続してそのメリットを患者さんが漏れなく享受するにはとても大事なことです。

例えば、喘息の治療をする場合、吸入薬を使いますが、吸入薬にはそれぞれメリットとデメリットがあります。

1日1回で済む吸入薬、調子の悪いときに追加で使用できる吸入薬、吸ったことを確認しやすい吸入薬、声がれの出にくい吸入薬・・・

人によってどれを重視すべきかは様々です。

その方の考え方、性格、職業、生活リズムなどなどによっても最適な吸入薬は変わるわけであり、最適な薬を選ぶことができるのは、その方の特性の理解が欠かせないのです。

私たち医師は、そんな患者さんのキャラクターまで見て、治療を考えているのです。

「答えがない」問題に答える

また、医学にはまだはっきりとはわからないことも少なくありません。

データだけでは見えないものというのも、確実にあります。

特に呼吸器分野は、症状がデータで測れないことが非常に多いのが特徴でもあります。

咳の代表的な原因である喘息は、採血やレントゲンでは異常が見られないのが普通ですし、喘息の診断に有効な呼気一酸化窒素試験でも数字が上がってこない喘息は山ほどあります。

データとして何も出ていなくても、実際症状がある場合、診断は困難を極めます。

こんな時、やはり医師としての経験に基づく「直感」が診断に結び付くことも、まだまだあるものなのです。

私もどうしても診断に迷ったときにチャッピー(→chatGPTのことね)に聞いてみることもあるのですが、結局自分の直感と合わないなって感じた場合、結果的にはAIの診断より自分の直感が当たっていたということの方が多いものです。

それに医学は「必ず答えがある」学問ではありません。

数年前まではどうにも治療できなかった「難治性の咳」の原因も、そのメカニズムがこの数年で解き明かされました。

でもおそらく、まだわかっていない咳の原因も、おそらくはまだたくさん残っています。

そのような「答えのない」状況でも、人間の医師はより患者さんにとって「ベター」な状態を目指して、患者さんと相談しながら方針を立てていきます。

そのような「マニュアル」的な対応は、まだAIには難しいところでしょう。

人間の医師しかできないこと

現時点のAIは、やはり典型的ではないインプットに答えられるだけの臨床推理はまだ難しいのなと思っています(あくまで「世間に公表されている集合知のまとめ」というそのAIの性格上、それは仕方がないことなんじゃないかと思っています)。

やはり、そこをカバーする「人と人の関係」が、正しい診断にはとても大事だったんだということを、これだけ進化した今の時代のAIを使って思いました。

そうした“人と人との間に生まれる気づき”は、どれほどAIが進歩しても廃れるものではないものだと日々感じています。

逆に言えば、今後そのような関係性を築こうとしない医師は、AIに取って代わられる存在となりうるわけです。

そのような医師は、そう遠くない未来に、AIに駆逐されてしまうのでしょう。

私たちは常にそのことを肝に銘じておかなければならないと思っています。

「平塚」でも大切にしたいこと

当院はこれまでも、気軽に立ち寄って、話していきたいと思っていただける雰囲気を大切にしてきました。

「こんなことで来ていいのかな」と迷われている方にも、気兼ねなく来ていただけるクリニックでありたいと、ずっと思っています(そういいながらも予約が取りづらくなってしまっていることが大変心苦しいのですが・・・)。

今回の平塚の新クリニックの設立も、そのようなコンセプトをより広げ、より多くの方に頼ってほしいとの思いで動き出したプロジェクトです。

そのような中で、患者さんとの濃密なやりとりを通して問題を解決するという姿勢が幸いにも周りに伝わっていたことが、ひょっとしたら今回の紹介につながったのかな、なんて考えています。

人とAIが「最高のコラボ」をするために

AIなどの新しい技術は、医療に限らず、社会のいろいろな面を支えてくれる大切な存在になるでしょう。

ただ、それを一番メリットの大きい形で使いこなすのは、やはり人の役割、人と人とのコミュニケーションなのだと思います。

技術だけでも、人の気持ちだけでも十分ではなく、その二つがうまくコラボレーションすると、最も良いものが生まれる ーーー

それの最たる分野が医療だと思っています。